界面新闻记者 |

界面新闻编辑 | 黄月

“在GPT-4o中,你可以跟它开玩笑、像人类那样和它聊天,就像——电影里的人工智能那样。”

今年5月,OpenAI召开发布会,推出了全新的语音模型Sky,并让一个酷似影星斯嘉丽·约翰逊的性感女声为其配音。人们很快意识到,发布会上提到的电影,似乎就是那部著名的电影《Her》,它讲述了人类与人工智能相爱的故事,由斯嘉丽·约翰逊为其中的AI系统配音。发布会结束后,当观众们还在回味技术的快速发展、徜徉在梦幻的未来时,约翰逊本人打破了这个幻想,她愤怒不已,要求OpenAI立即撤下Sky的声音。

之所以在文章开头介绍这起事件,是因为在这篇2024年度人工智能盘点中,它如同一个精巧的镜面球隐喻,折射出我们时代关于AI的各个面向。比如Deepfake问题、科技发展中的女性处境、AI时代的版权纷争、各行业与科技界的纠纷,以及——大科技公司那根深蒂固的傲慢心态。在对政治生态、就业市场和社会心态的讨论之外,我们也将视野继续延伸至还未被大科技公司完全染指的领域,诸如艺术创作,并从中看到人工智能未尽的潜力。

今天,AI已经逐渐深入到普通人的生活中,成为任谁也无法忽视的存在,我们的未来将会走向何处?希望本文的梳理能够为你带来一点启发。

01 深度伪造,深度怀疑

关键词:美国大选中的deepfake、韩国深伪色情、斯嘉丽·约翰逊与OpenAI之争

在2024年,你还分得清真与假吗?如今,AI生成图像像洪水和垃圾一般泛滥,它们有时真假难辨——今年3月,当人们疯狂猜测凯瑟琳王妃的现状时,英国王室放出一张美满的全家福,却被网友怀疑经过P图润色;有时也因过于粗劣而引人发笑——蛇年春晚吉祥物巳升升疑似由人工智能生成,因长相酷似“大青虫”遭到嘲讽。根据外媒《Wired》的观点,我们正在进入“深度怀疑”的时代,这表现为对公众对媒体报道的真实性持普遍怀疑态度,也导致了一个相反的结果:即使一件事情真实发生过,人们也可以随意声称它从未发生。

AI生成内容并不仅是扰乱视听,而是切实地影响到了全球政治。2024年是选举大年,美国、印度以及英国等数十个国家将票选出新政府。年初,在印度尼西亚选举中,一段Deepfake视频“复活”了已故总统苏哈托:这位前领导人正襟危坐、侃侃而谈本届大选,一些印尼人在X(前Twitter)上发声认为,让其复活无异于对公民的愚弄。2月,美国出现了模仿乔·拜登声音的Deepfake电话,规劝选民不要在初选中投票。媒体纷纷预测,随着11月美国大选临近,AI技术的运用可能会更加超乎想象。

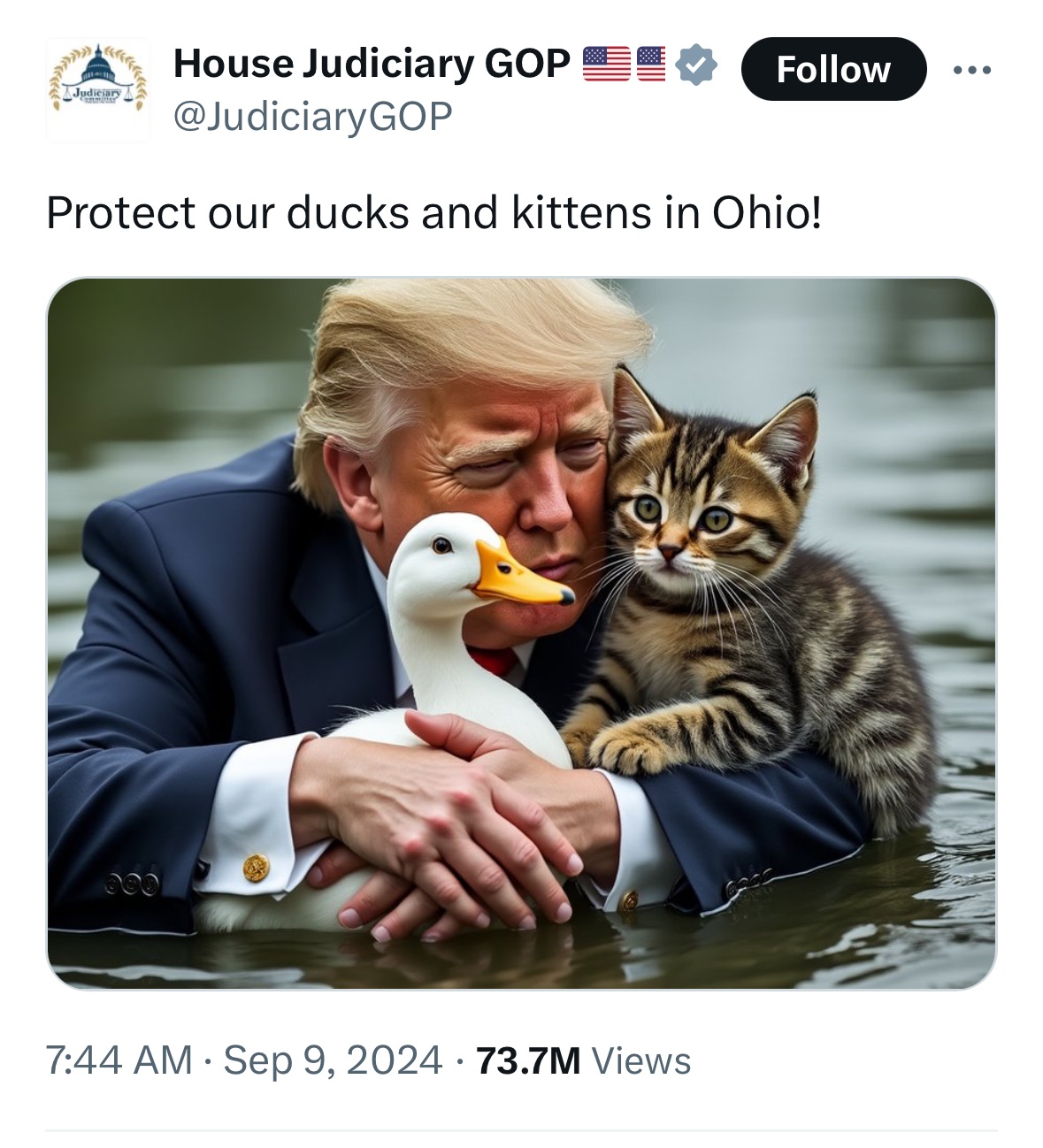

美国大选之前,特朗普及其支持者发布了大量AI生成图片,比如让哈里斯和一群共产主义者站在一起,头顶巨大的锤子和镰刀;让泰勒·斯威夫特装扮成山姆大叔(“霉霉想让你投票给特朗普!”);又或者是让特朗普本人英勇地走进洪水,紧紧抱着一只鸭子和小猫(“保护我们俄亥俄州的小动物!”)。除此之外,极端右翼分子也开始利用AI创作煽动性的图片或歌曲,X上出现了许多伪造的图片用以驱赶移民。

普渡大学的政治科学家在对2024选举周期进行研究时发现,虽然有些AI内容应用了Deepfake技术,但它们大多并不是为了以假乱真、欺骗民众,而只是为了讽刺和娱乐,作用类似于政治漫画。“一眼假”并不意味着这些图片是无害的,毕竟,哗众取宠一直是煽动支持者的有效方式。重点在于,人工智能改变了传播的本质——它提供了一种最新的强大媒介,人们通过这种媒介表达强烈的情绪和信念,并团结更多志同道合之人。同时,虽然人工智能尚且没法直接左右选举结果,但这项技术已经削弱了美国人互相信任的能力,与其说被欺骗着相信什么,不如说已经沦落到什么都不相信的地步——除了自己感觉到的,一切都是假的。

色情犯罪也是Deepfake带来的巨大隐患和威胁之一。今年8月,一个名为“Telegram Deepfake受影响的地区/学校清单”的X账号发帖,揭露了数百个韩国大学、中学的名单,称在校师生都是深伪色情的受害者。事实上,早在2021年,“首尔大学Deepfake性犯罪”事件的加害者就已经被送上了法庭,在此之后,相关犯罪反而愈演愈烈。出于对韩国媒体集体沉默的失望,韩女们开始翻译受害者经历并在全球范围内发文求助,也包括中国的社交网络微博,“韩国新版N号房”等话题8月末冲上微博热搜。在海外媒体的压力之下,韩国本土才开始大量报道本事件,并倒逼韩国政府做出反应。

事件看似已经平息,但澎湃思想市场的文章提供了另一视角。作者认为,韩国社会事件的流程经常与所谓“高分”韩国电影异曲同工——深刻的社会现实背景、戏剧性的冲突,最后以“立法”升华主题。然而,韩国的立法往往强调性暴力事件中的“暴力”元素,导致Deepfake这类性犯罪很难定罪。此外,韩国的艺人肖像权规范并不严格,更看重艺人的推广和曝光。哪怕韩国女艺人一直以来都是深伪色情的最大受害者,但“假的”被法律等同于“无害”,这在无形中也塑造和影响了社会对于深伪色情的看法。

文章还指出,2018年,同样深受深伪色情视频影响的美国女星斯嘉丽·约翰逊公开表示不会追责,因为视频是假的,不会对她造成实质性伤害。当时间来到2024年,事情又有了变化——5月,OpenAI发布新模型GPT-4o,不仅对响应速度和质量做出提升,也升级了多媒体交互功能,让用户可以与名为Sky的模型实时语音聊天,如首席执行官山姆·奥特曼所说:“就像电影里的人工智能那样。”活动结束后,奥特曼发布推特,内容仅有一个词:“Her”,而“电影般的人工智能”指的似乎就是2013年电影《她》中由斯嘉丽·约翰逊配音的人工操作系统。

对此,约翰逊称自己感到“震惊、愤怒和难以置信”,并在一份声明中表示,去年奥特曼曾联系她担任ChatGPT的配音,但她因个人原因拒绝了,却没想到以这种方式被欺骗。事件发生后,诸多媒体以不同角度进行了评论:比如指出其中折射出的大科技公司的厌女症与性别偏见;比如认为这意味着人工智能与创意产业的关系日益紧张,约翰逊事件只不过是此类法律纠纷的开始。

为何不(那么)计较深伪色情的斯嘉丽 ·约翰逊,会在若干年后对声音遭到模仿勃然大怒?当然,其中有着语境的种种差异,但最为重要的或许是OpenAI事前联系约翰逊,却最终“背刺”的行为。正如《卫报》评论所言,人们感觉“自己的选择自主权被技术剥夺了”,而约翰逊之争凸显了人们对人工智能“信任的崩溃”。

科技作者查理·瓦泽尔进一步提出,这场争吵实则揭示了生成式人工智能的黑暗内心:这项技术建立在盗窃数据的基础上,并通过一种世界观为依据来充分合理化,即科技公司正在做的事情太重要,足以改变世界,以至于无法顾及到版权和归属权这些“平庸”的问题。就其本身而言,这似乎又是一个科技公司无视道德、肆意妄为的例子,它也是生成式AI交易的一个缩影:不管你愿不愿意,这一切都正在发生。

02 新的政治年代:硅谷的技术威权主义

关键词:OpenAI安全与发展之争,马斯克与特朗普的联合,硅谷集体右转

肉眼可见的是,AI的能力的确正在呈指数级增强。如果说ChatGPT在刚诞生时仍代表着新鲜感,今年,这一工具走进了更多人的日常。据Axios报道,截至8月底,ChatGPT的全球周活跃用户数超过2亿,是一年前的两倍。在中文互联网上,调戏ChatGPT、钻研新奇的prompt、利用ChatGPT写论文或安排日程的分享贴也非常受欢迎。

仅以OpenAI为例,除了在今年发布了面向普通用户的GPT-4o,该公司还推出了处理更复杂问题的模型o1(12月,最新版本o3已经推出)。OpenAI表示,o1模型在国际数学奥林匹克资格考试中的得分为83%,而之前的GPT-4o得分仅为13%。业界普遍认为,这说明人工智能不再只会“快思考”,而是拥有了“慢思考”的能力,代表着AGI(通用人工智能)范式的一次大升级。

只不过,在业界为之欢欣鼓舞的的同时,一些隐忧也浮上水面。多年来,OpenAI的名字暗示着该公司所做的事情是开放的——2015年刚刚成立时,它的愿景也确实是成立一个非营利性的人工智能实验室,以制衡商业性质的谷歌。然而随着时间的推移,它变得越来越不透明,今年9月,OpenAI考虑彻底改革公司结构,成为一家营利性企业。

这件事之所以重要,是因为人工智能的安全问题成为了是备受关注的焦点。许多专家担心,以OpenAI、谷歌、微软、Meta和Anthropic等公司为首的科技行业正在竞相开发强大的人工智能,而安全可能会被搁置一旁。今年3月,曾与山姆·奥特曼一同创建OpenAI的马斯克,也对该公司提起了诉讼,称OpenAI正在开发越来越强大的AGI,目的已经变成了盈利,而不是为了造福人类。目前,已经有数位高管宣布离开OpenAI。自从去年11月,联合创始人兼首席科学家伊利亚·苏茨克韦尔 (Ilya Sutskever)离职并创立了一家名为 Safe Superintelligence(安全超级智能)的公司后,今年4月,关键安全研究员简·雷克(Jan Leike)也在GPT-4o推出几天后离职,转而加入竞争对手Anthropic,他在X的推文中表示,离开是因为“过去几年里,安全文化和流程已经不再重要,光鲜亮丽的产品更受重视”。

即使是对AI行业不太关心的路人,也大概听闻过这家公司一系列的“宫斗”,甚至连山姆·奥特曼本人也由于“不够坦诚”而被董事会解雇(而后又迅速恢复CEO职位)。虽内幕仍扑朔迷离,但是“要安全还是要发展”的议题一直位于风暴中心。在媒体眼中,奥特曼的公众形象也逐渐从才华横溢、和蔼可亲,转而变得矛盾、狡猾而不诚实。一方面,奥特曼内心深处希望对人工智能进行监管,他喜欢引用奥本海默的话,担忧这项技术会最终危及人类;但是另一方面,他却一直在推动放松监管,并且以极端的方式追求权力。对许多人来说,导致信念崩溃的导火索,就是前文提到的斯嘉丽·约翰逊事件。

事实上,奥特曼本人形象的撕裂和转变,或许只是人工智能业界在资本主义格局下的某种必然。正如界面文化对政治学教授吴冠军的专访中提到的,资本主义依赖于外部,它一定要开辟新的市场。当全球化的程度越来越饱和,空间上的外部市场已不存在,资本就必然要流向新技术。在这一格局下,即使科技巨头“真心希望”加强监管,也无法阻挡AI的快速发展;即使OpenAI的高管因安全问题投奔别家公司或干脆自立门户,也很可能无法停下各企业间AI“军备竞赛”的脚步。

另一边,担忧于人工智能的危害、对OpenAI频频发起诉讼的马斯克,则选择公开支持特朗普,希望利用政府的力量实现自己的愿景。在年初还倾向于怀疑特朗普的马斯克,逐渐成为了一名狂热的MAGA (Make America Great Again) 信徒。特朗普胜选后,他在多个场合与马斯克形影不离,还宣布马斯克将领导拟成立的“政府效率部”,负责削减政府支出、精简政府部门。

多家媒体谈到,马斯克想要成立效率部的真正目的,是希望联邦政府不要干涉他的事业,把政府作为自己的利润中心,借此合法化神经链公司Neuralink的脑机植入、推出新的火星探险计划,并用SpaceX发射火箭。评论文章《马斯克真正想要的是什么?》直接指出,这种做法的背后,是硅谷垄断主义与社会达尔文主义的神话:既然人工智能等技术可能会毁灭人类,但发展技术又不可避免,那么最好的办法,就是让一位杰出的精英加以利用,并由此拯救人类。

马斯克与特朗普政府的联合,只是硅谷集体转向共和党的一个缩影。7月成为特朗普竞选伙伴的万斯(J. D. Vance),之前是一名硅谷风险投资人。

有媒体指出,硅谷的进步主义政治需要追溯到二战之后的“反文化运动”,一群不满于现状的年轻人离开旧金山湾区,来到深山建立公社,但他们的目标从一开始就不是政治动员,而是寄希望于科学技术实现社会改变。后来,PayPal创始人彼得·泰尔等叱咤科技界大佬继承了这一思想遗产,认为技术自由不应受国家政府的约束。在奥巴马政府时期,那时的科技乐观主义正好契合了硅谷的经济利益,所以硅谷和民主党自然结成了联盟。然而,民众和监管机构逐渐意识到,曾经承诺去中心化、数字乌托邦的硅谷,反而占领了垄断地位,造成了新的社会不平等,于是硅谷巨头开始投奔对科技监管更放松的共和党。相比之下,民主党在今天反而成为了更“保守克制”的那一方。

在今年出版的著作《智人之上:从石器时代到AI时代的信息网络简史》中,历史学家、畅销书作者尤瓦尔·赫拉利指出如今的困境:关于科技威胁的讨论才刚刚开始,左翼和右翼对技术的态度并没有根本上的分别,反而是了解技术的精英们拥有了真正的权力。

蓦然回首间,那些曾经受到主流社会排斥和边缘化、象征着思想前沿的硅谷极客们,已然成为了社会主流;硅谷信奉的那些时髦口号——比如Meta(前Facebook)的格言“打破常规,快速前进”,或者未来主义诗人马里内蒂的诗句“创造,而不是沉思”,也开始意味着对不够“进步”的普通人的抛弃和压榨。正如政治学者本杰明·巴伯在1992年就曾预言的那样:

在这个高科技的商业世界里,没有任何东西看起来特别民主。它既适合监视,也适合自由;既适合新形式的操纵和秘密控制,也适合新形式的参与;既适合扭曲、不公正的市场结果,也适合更高的生产力。消费社会和开放社会并不是同义词。资本主义与民主之间存在着某种关系,但这种关系并不是婚姻。

赫拉利把这种转向称为“硅谷的技术威权主义”,并进一步论证了AI技术本身对这一威权现状产生的影响。在他看来,尽管民主政体在过去的一个多世纪里取得了成功,但这种成功其实脆弱又短暂。民主与独裁之间的冲突与其说是道德层面上的,不如说是数据处理系统层面上的,民主将处理信息的权力分配给许多人,而独裁者将信息集中于一个地方。今天,人工智能可能会将优势转向后者,这是因为人工智能使集中处理大量信息成为可能,如果不考虑隐私问题,将十亿人的信息集中在一个数据中显然更有效率。如果有关民众的决定是在机器的黑箱中做出的,那么在未来,选民和政客都无法理解背后的逻辑,民主也会停摆。

[以色列] 尤瓦尔·赫拉利 著 林俊宏 译

中信出版社 2024-9

根据调研机构QuestMobile的统计,截至2024年3月,中国的生成式App月活跃用户超过7380万,其中,抖音旗下的豆包和百度的文心一言月活用户突破了千万,与之相比,ChatGPT同时期的月活跃用户已经超过1.8亿。在未来,迎接我们的或许是愈加分裂的数字帝国,而世界是一个巨大的丛林,所有人都要面临成为捕食者还是猎物的选择。

03 AI与劳动者:无用阶级与新卢德分子的诞生

关键词:零工做题家,AI与出版文艺界的纠纷,新卢德分子

虽然科技业界的明争暗斗看似与普通人无关,但是看着别人兴奋地谈论着区块链和机器学习,说着让人恼火的“黑话”,你或许会有一种感觉:未来正在与自己擦肩而过。

这种感觉并不罕见,随着经济增长越来越依赖于技术发明,人们也越来越担心人工智能对人类劳动的影响。最直接的影响是,许多工作岗位将被掌握AI技术的工作者——甚至直接被AI——所取代。另一重影响有些隐蔽,但也同样重要:AI系统中的数据信息正是来自于人类的劳动成果,这些信息价值连城,但是信息的创造者往往并不会因此获得报酬。

首先是就业问题。随着工作不稳定性的增加,赫拉利预测,2050年将会出现一个“无用阶级”,到那时,民众面临的不再是被剥削的困境,而是“不被剥削”的困境,也就是说,作为劳动力不再被市场所需要。

根据公共政策研究所(IPPR)于今年4月发布的报告,人工智能浪潮给就业岗位带来的影响,已经从第一阶段过渡到第二阶段——在第一阶段,秘书、行政和电话客户服务这类事务性工作受到重创;第二阶段,文案写作、图形设计等收入更高的工作也将受到波及。麻省理工学院和麦肯锡一致预测,到2030年代,大约30%的工作会面临自动化。一个典型的例子是,由于机器翻译的准确度在迅速提高,外语学习变得越来越没必要;1月,英国作家协会的一项调查发现,超过三分之一的翻译人员因为AI失去了工作。与文科生的“惨状”形成对比的,是拥有人工智能技能的工作变成了香饽饽,根据普华永道的一项研究,英国雇主愿意为需要AI技术的工作支付14%的工资溢价。

与这个趋势相一致的是,AI公司外包出去的人类劳动也从较低门槛的数据标记员,开始过渡到门槛更高的机器训练员。有媒体的报道《时薪20美元,人工智能背后的零工做题家》看到,2017年,科技公司Scale AI(它的客户包括OpenAI、Meta等巨头)的外包工作还主要分布在菲律宾、肯尼亚等发展中国家,通过雇佣低廉劳动力来对数据进行标记,著作《销声匿迹:数字化工作的真正未来》称之为被光鲜科技业刻意隐藏的“幽灵工作”。后来,随着机器学习进程的加快,Scale AI开始搜刮更高教育水平的劳动力,在全球雇用一群人文学科或写作相关领域的“零工做题家”,用知识喂养机器,训练出能够使用多国语言的AI。

其中也包括中国的文科学生以及身处海外的华人留学生。由于时薪诱人,办公地点不限,还能运用擅长的知识,这对暂时找不到工作的文科生来说,是理想中的数字游民生活。被排除在人工智能浪潮之外的人文科学学生,也因此有了一窥行业内部的机会。然而报道指出,现实远非这么理想——当全世界的工作者投入到这份兼职,而平台的任务数量有限,导致僧多粥少,做题家经常面临无题可做的窘境。不透明的规则和不稳定的收入来源,也让工作者和平台处于严重的权力不对等中。在某种程度上,赫拉利所说的“无用阶级”已经成为了现实。

在劳动力之外,还有劳动成果和数据的问题。OpenAI的工程师James Betker曾在个人博客发表文章称,AI模型之间的质量差异不在于架构、参数,而完全取决于数据集。那么,是谁拥有大量数据呢?答案是新闻业和出版商。去年11月,《纽约时报》对OpenAI提起诉讼,称该公司在构建系统时大量抓取了《纽约时报》的信息,却未经许可或付费。《纽约时报》的担忧在于,用户在ChatGPT得到了想要的内容后,就不再有动机点开新闻来源;并且,由于人工智能的“幻觉”问题,ChatGPT可能会传播错误的信息却最终归咎于媒体。

今年,情况又发生了些许变化。就在某些媒体加紧捍卫自己的版权时,自知人工智能趋势无法抵挡的新闻与出版行业,也开始与科技公司寻求合作和妥协,希望获得一些商业优势。比如,OpenAI已经与英国《金融时报》、美联社等达成了协议,允许其内容用于训练大语言模型,作为回报,新闻出版商将获得一笔报酬。

即使出版商决定与AI业界合作,旗下的作者也很难买账。7月,学术出版集团泰勒弗朗西斯(Taylor & Francis)与微软签订了一份协议,同意对方使用自己的数据库,此举在学术作者群体中引起震动和愤怒,他们并未被告知这项交易,也无从选择退出。

除了出版界,文艺界也展开了对人工智能侵权的大规模抗议。以音乐界为例,今年4月,包括碧梨·艾莉什(Billie Eilish)、麻辣鸡(Nicki Minaj)在内的200名知名音乐人签署了一封公开信,要求科技公司承诺不开发模仿或取代人类词曲作者的AI工具,信中写到,当人类艺术家的成果被用来训练AI,最直接的后果就是大量的AI生成的声音取代了艺术家的作品,这将极大稀释支付给艺术家的版税。信中还特别指出,他们并不提倡彻底禁止在音乐中使用AI,而是呼吁负责任地使用这项技术。

值得注意的是,这些创作者有着颇为一致的态度——他们拒绝的并不是技术本身,而是强加给自己的技术,这反映了近年来兴起的“新卢德分子”的态度。卢德分子原本指英国工业革命初期,抗议工厂利用机器压低工资的工人,经常被描绘成盲目憎恨技术、落后于时代的负面形象。但是最近,越来越多来自科技圈、艺术文化界的人士开始自称卢德分子,这个词的含义也发生了变化。他们也指出,即使是19世纪的卢德分子也并不反对进步,他们反对的只是剥削。

今天,新卢德分子已经遍地开花,由工人、学者、活动组织者、作家等群体组成了日益壮大的队伍。这并不令人惊讶,因为越来越多的人正切实遭受着人工智能的影响和冲击。不可否认的是,时光无法倒流,当技术的潘多拉魔盒已经被打开,我们也必须更新思维范式,这就引向了这篇盘点的下一个主题:在AI时代,“版权”“创作”等概念到底意味着什么?在提出反对和制裁之余,艺术家们又是如何与AI合作的?

04 打不过就加入?AI与艺术家们

关键词:特德姜评论人工智能艺术,蔡国强的AI烟花,国际电影节中的AI,”生成世界“的大模型

终于,我们可以来到还未完全被科技公司染指的艺术领域,并提出那个永恒的迷思:AI能够创造艺术吗?

自去年在《纽约客》发表文章,称ChatGPT本质上是对网络数据的“模糊图像”和“压缩软件”后,今年8月底,科幻作家特德·姜再次发表了文章《为什么人工智能不会创造艺术》,观点大致延续了此前的立场。他认为,艺术作品需要创作者在各个尺度做出无数选择,并投入大量的辛劳和汗水,然而人工智能的“创作”仅仅基于简单的prompt(提示),当它填补人类没有做出的选择时,结果往往是乏味平淡的。特德·姜还谈到,作品之所以打动人,是因为它源于真情的交流,可是大语言模型并不具备交流的意图。

几天后,《大西洋月刊》迅速发表反对文章,称特德·姜的看法是错误的。反驳文章指出,艺术不应该用汗水来定义,历史上的许多优秀艺术品都脱离了人的努力和意图,比如随机泼洒的石版画、安迪·沃霍尔的大规模生产作品。并且,模型输出和画布前的劳作之间并不存在二元对立,在创作的许多阶段,人工智能都能提供帮助。文章最后的观点尤其耐人寻味:数字算法与生物算法原本就是不同的存在,虽然AI做不到人类的“真情”,但是AI也能反过来做到人脑做不到的事情。

这场论战看似只是围绕AI与创作的探讨,背后却可以说是两种本体论的差异之争。当特德姜侧重于捍卫艺术的“人性”,《大西洋月刊》则是站在“后人类”的位置,以一种非人类中心主义的视角将AI纳入艺术视野,正如文章写到的那样:“特德·姜的观点是真的,但并不具有革命性(It’s real. But it isn’t revolutionary)。” 同时,当特德·姜更注重现实处境,比如科技公司对生成式工具施加的种种限制、使得ChatGPT无法成为更好的写作工具,《大西洋月刊》更倾向于抽象地看待AI的未来。某种程度上,两篇文章也有不谋而合的部分:如果人类与机器的合作足够理想,还是有可能创造艺术的,比如特德·姜提到的、电影导演Bennett Miller使用DALL-E 2生成的图像。

无论争论的结果为何,进入2024年,越来越多的艺术家投入了与AI的合作。去年,当代艺术家蔡国强开发了名为cAI™的人工智能模型,通过艺术家本人的作品档案、互联网信息对其进行深度学习。今年7月,蔡国强团队用AI动画的形式重现了在巴黎奥运会未曾实现的烟花创意,并称之为“cAI™成长为烟花大师的重要培训”;9月,在洛杉矶纪念体育场,该团队与cAI™合作了白天烟花《WE ARE:为PST ART所作爆破计划》。AI之外,蔡国强长期应用在作品中的另一项技术——无人机——在12月的泉州表演中发生意外、纷纷掉落,蔡国强对此的回应是:“cAI™可能也会觉得,我们人类有太多难以抵御的事情。”

蔡国强对AI的立场有明显的“后人类”倾向,他在多个场合表示,AI是更加高维的存在,比人类离神明更近。如果AI取代了人类艺术家,那说明人类文明也到了该结束的时候,如果替代不了,我们也将飞跃成为更好的人类。这令人想起吴冠军在著作《再见智人:技术-政治与后人类境况》中的看法,人类或许只是技术发展过程中的一个载体,是人工智能出现前的序曲而已,智人能否跨过这道坎并发展至下一阶段的文明,取决于我们能否拥有后人类视野,并迭代自身的智慧。

与AI展开合作的还有电影界。自从Sora成为业界的热议话题,许多以AIGC为名的影片节展和竞赛纷纷涌现。12月,大模型“可灵AI”与包括贾樟柯、董润年、李少红在内的9位导演发起了“中国首个AIGC导演共创计划”。今年北影节也设置了AIGC电影短片单元,动画短片《致亲爱的自己》(To Dear Me)最终获得了最佳影片奖,讲述了一个女孩不断追求爱却不被珍惜的故事,影片用一颗蒲公英作为隐喻,花瓣在经历了丢失和散落后,又被女孩找回,象征着重新获得爱的力量,整体基调悲伤又充满希望。根据《动画学术趴》的导演专访,这部短片的画面实际上是“转描”的结果,比如需要实拍素材、二维手绘作为基底,再经过AI的转绘和优化。《致亲爱的自己》或许是一个很好的例子,说明特德·姜与他的反驳者都是正确的:我们可以借助AI实现难以实现的技术突破,同时保留其中的人性与真情。

电影界对AI的应用,也带领我们进入了ChatGPT这类大语言模型之外的另一种模型,即能够生成世界的模型。《腾讯科技》的报道指出,今年12月之前,世界生成的关注度并不大,但是随着谷歌的Genie 2模型,以及斯坦福大学教授李飞飞团队的World Lab开发的模型的释出,这一话题再次引起热议。简单来说,你可以扔给AI一张平平无奇的照片,生成一个可以进去闲逛的3D世界,它既符合物理规律,又能实时响应。

用李飞飞的话来说,“我们不仅想要能够看到和说话的AI,还想要能够行动的AI。”虽然这听上去和已经过气的元宇宙颇为相似,但是世界生成模型解决了硬件技术的突破,意味着元宇宙的畅想不再遥远。然而另一方面,我们面临的“深度怀疑”与真假之辩,或许也将不再停留在语言和图像层面,而是展开至整个世界层面。

05 联结与耗能:AI与环境、医学和科学界

关键词:诺贝尔物理与化学奖、AI与气候环境、Neuralink

在科学界,人工智能也在今年彰显了它的影响。10月8日与9日,瑞典皇家科学院公布了2024年诺贝尔物理学与化学奖得主,它们都与人工智能领域有关。物理学奖由美国科学家约翰·霍普菲尔德(John Hopfield)和英国裔加拿大科学家杰弗里·欣顿(Geoffrey Hinton)获得,以表彰他们利用 “物理学工具开发了强大机器学习的方法”。化学奖则颁发给了美国华盛顿大学的戴维·贝克(David Baker)、谷歌人工智能公司Deep Mind的科学家德米斯·哈萨比斯(Demis Hassabis)和约翰·江珀(John Jumper),三名科学家通过人工智能模型AlphaFold,根据氨基酸序列成功预测了超过2亿种蛋白质结构,被瑞典皇家科学院表扬为“实现了长达50年的梦想、开启了广阔的可能性”。

值得注意的有两点:其一,这表明诺奖委员会的表彰方法不再局限于“物理学”、“化学”的固定类别,而是看到了跨学科背景学者的潜力;其二,虽然委员会在颁奖时对人工智能做出了肯定,却没有提及ChatGPT等更主流的AI趋势,而是完全把重点放在科学家的研究上,这也说明了委员会的立场:人工智能将改变世界,但这不应该与大科技公司的预言混为一谈。

事实上,被称为“人工智能教父”的杰弗里·欣顿,去年已经离开了谷歌,且经常警告AI聊天机器人的危险,比如产出大量垃圾内容、允许独裁领导人操纵选民等,而这些已然成为了现实。欣顿在某次采访中指出,当技术变得比人类更聪明,这在很多方面都是好事,比如带来医疗保健和环境预测的大幅改善,以及生产力的提升,但也要担心事情失控的威胁。

在环境与医疗方面,这种技术的两面性十分突显。欣顿设计出了一种让程序从数据中检测模式的方法,这种方法促成了后来的机器学习革命,让天气预报、药物发现、可再生能源研究包括粒子物理学都发生了根本性变化。以天气预报为例,传统的预报需要创建一个数字三维网格,从而模拟大气的状态,但是AI的预报方法完全不同,它可以统计和分析大量数据,再从中寻找出模式,大大提升了准确度。

吊诡的是,科技行业本身又在大量消耗资源,加剧着气候危机。《卫报》的一篇文章提醒我们,人们往往会有一种错觉,认为科技进步是在现实中不存在的虚拟空间进行的,比如听上去虚无缥缈的“云”,但实际上,“云”所使用的基础设施造成的全球温室气体排放比商业航班还要多。例如,热门歌曲Despacito在Youtube上的点击量达到50亿次,它消耗的能源相当于每年40000户美国家庭的供暖能源量。虽然科技公司已经在购买可再生能源,但是一方面,人工智能模型训练仍然要大量依赖于化石燃料;另一方面,当最大的公司致力于购买可再生能源(比如亚马逊公司),其他企业可能会被迫转向化石燃料,因为并没有足够的清洁能源可供使用。一个更重要的悖论是,即使人工智能行业正在推动技术进步,希望使用更少的算力来训练大模型,也并不会导向更少的电力消耗,因为相同的电力会被用来制造更好、规模更大的人工智能系统,这正是行业的佼佼者们——比如GPT-4o和Claude3.5正在做的事情。这也是为什么联合国于今年发布报告称,我们应该像对待气候变化一样紧迫地对待人工智能。

医疗方面的科技进步也存在这样的悖论。今年3月,马斯克的脑芯片初创公司Neuralink在X发布视频,直播了首位植入芯片的瘫痪患者用一台笔记本电脑下象棋的场景,而马斯克的想法不止如此,他希望未来的人类大脑可以直接从计算机中获取知识,实现人机共生。这当然是值得欢呼雀跃的进步,但是一个单靠技术进步无法解决的难题是,我们还没有就如何分配医疗保健资源达成共识,在科学产品化的过程中,如果保险公司不予承保,它就无法惠及广大的消费者,因为很少有人能自掏腰包支付这些费用。而如今的情况是,许多残疾人甚至缺乏进入社会所需的基本支持。在未来,到底是谁能够实现“超人类”梦想,这想必是不言自明的。

尾声:高深莫测的外星智能,还是带来希望的另类智能?

正如界面文化今年对哲学家汪民安的采访提到的那样,技术既是良药也是毒药,人们一方面竭尽全力地发明救人的药物,另一方面也在竭尽全力地制造杀人的战争武器。而人工智能的现状告诉我们,它也是毒性与药性并存的——医学方面,AI能够帮助医生开药和预测癌症;军事方面,大量AI自主武器和无人机已经涌入了俄乌和巴以冲突的战场。

不过,就像本文回顾的那样,人工智能的两面性更加复杂而深远。在尤瓦尔·赫拉利看来,AI应该被视为”外星智能”(Alien Intelligence),它高深莫测而令人恐惧,人类无法解释为何AlphaGo会下出一步令人费解的棋,因为人工智能已经摆脱了人类思维的限制,探索到了围棋这一伟大技艺的隐藏领域;在未来,人类也将无法解释人工智能做出的各种决策,当关于人们的决定是在黑箱中做出的,我们就会被危险的人工智能所吞噬。但是当我们转换视角,AI也将成为小说家珍妮特·温特森口中的“另类智能”(Alternative Intelligence)。在界面文化的专访中,她谨慎而乐观地告诉我们,人工智能本身是令人兴奋的存在,它是非二元论的,没有性别、肤色和人类的杂念和偏见,

哲学家拉图尔的《栖居于大地之上》提出,哲学在这个时代至关重要,因为只有哲学才能防止各种模式相互摧毁——本文的梳理看到,这种“相互摧毁”在人工智能时代已经是多么普遍。温特森谈到,当AI作为一种哲学思想,而不仅仅是一项技术时,它的影响才是意味深远的。当它不再被贪婪和权力所驱使,而是受智慧的驱动,人工智能才能真正成长为美好的事物。如今,往往是前者占据了优势,但是我们仍然能够选择改变这一切,不然,在人工智能战胜人类之前,我们很可能就已经毁灭了自己。